AI Trends

오픈소스 LLM: GPT OSS, Qwen 3, 그리고 DeepSeek V3 비교 분석

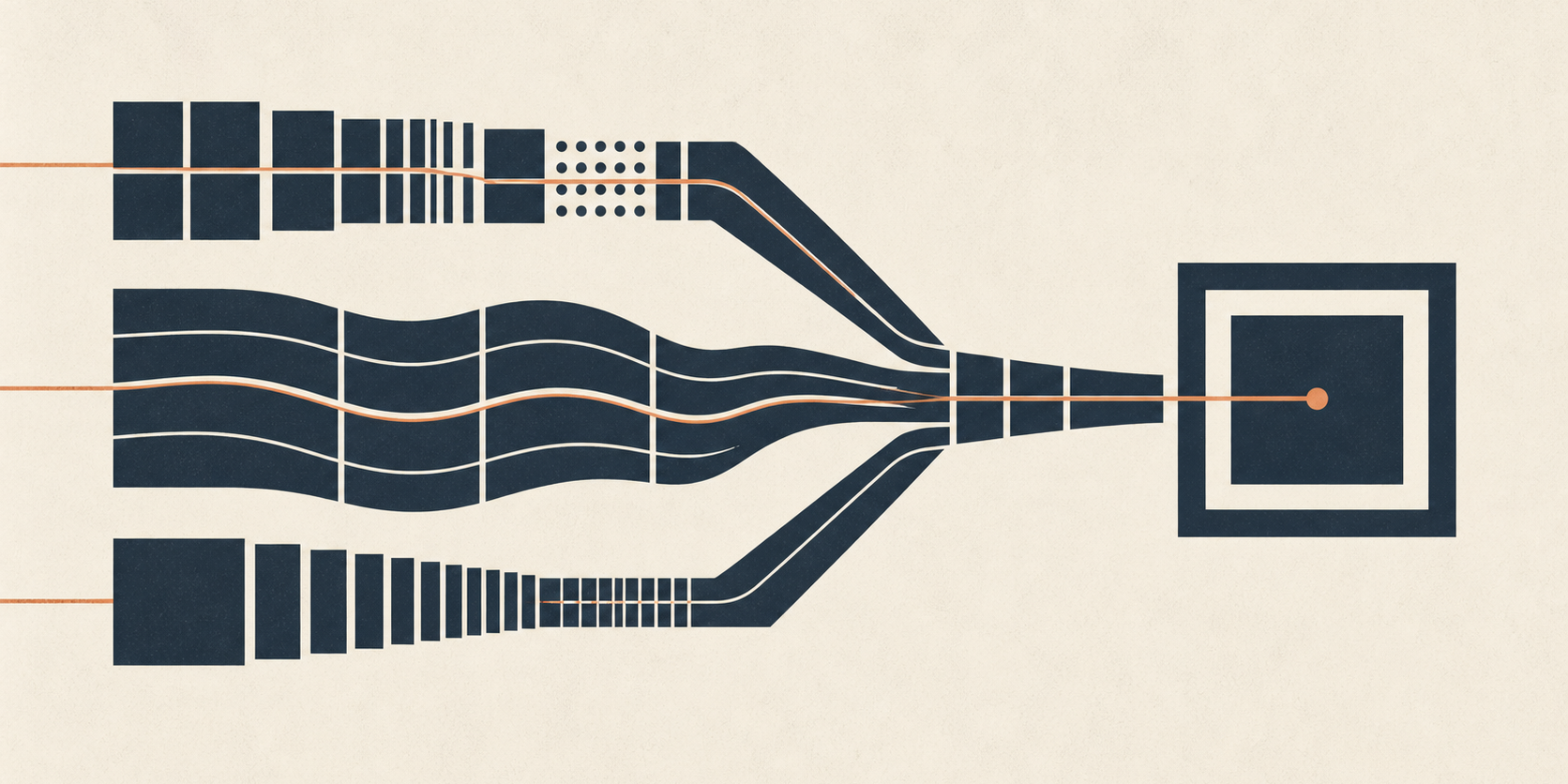

오픈소스 언어 모델이 기술적 정점에 도달함에 따라 기업의 AI 도입 전략도 변화하고 있습니다. OpenAI, 알리바바, 딥시크의 최신 아키텍처를 분석하여 비즈니스 가치 창출을 위한 인사이트를 제공합니다.

OpenAI의 귀환

`GPT OSS가 제시하는 효율성의 기준`

OpenAI가 2019년 GPT-2 이후 오랜만에 선보인 오픈 웨이트 모델인 GPT OSS는 시장에 큰 반향을 일으켰습니다. 이 모델은 현대적 LLM의 표준으로 자리 잡은 Mixture of Experts(MoE) 아키텍처를 채택하고 있습니다.

GPT OSS는 1,200억 개의 파라미터를 가진 모델과 200억 개의 파라미터를 가진 두 가지 버전으로 제공됩니다. 흥미로운 점은 토큰당 상위 4개의 전문가(Expert)만을 활성화하여 전체 파라미터의 일부만 사용한다는 것입니다. 이는 대규모 모델의 장점인 높은 지능을 유지하면서도, 실제 추론 과정에서의 계산 비용을 획기적으로 낮추는 결과를 가져옵니다.

또한, GPT OSS는 131,000 토큰에 달하는 긴 컨텍스트 창을 지원합니다. 특히 주목할 기술적 특징은 YARN(Yet Another RoPE Extension) 스케일링을 추론 시점이 아닌 사전 학습(Pre-training) 단계부터 직접 적용했다는 점입니다. 이는 모델이 처음부터 긴 문맥을 이해하도록 설계되었음을 의미하며, 기업들이 방대한 문서를 처리하거나 복잡한 워크플로우를 자동화할 때 더 안정적인 성능을 기대할 수 있게 합니다.

Qwen 3

`유연성과 데이터 엔지니어링의 정점`

알리바바 클라우드가 선보인 Qwen 3는 오픈소스 모델 중에서도 가장 넓은 선택폭을 제공하는 것이 특징입니다. 60억 개의 파라미터를 가진 소형 모델부터 2,350억 개의 대형 MoE 모델까지 다양한 라인업을 갖추고 있어, 기업의 하드웨어 인프라와 예산에 맞춘 유연한 도입이 가능합니다.

Qwen 3의 성능적 우위는 압도적인 데이터 학습량에서 기인합니다. 이 모델은 무려 36조 개의 토큰으로 학습되었는데, 이는 이전 버전인 Qwen 2.5보다 두 배나 많은 양입니다. 특히 학습 과정에서 자체 모델을 활용해 교과서, 코드 스니펫 등 양질의 합성 데이터(Synthetic Data)를 생성하여 학습에 활용한 점은 데이터 엔지니어링이 모델 성능의 핵심 해자(Moat)임을 시사합니다.

사용자 측면에서 가장 혁신적인 기능은 생각하는 모드(Thinking Mode)의 도입입니다. 사용자는 필요에 따라 모델의 추론 과정을 강화하거나 생략하도록 설정할 수 있습니다. 이는 복잡한 논리적 사고가 필요한 수학이나 코딩 문제에서는 추론 성능을 극대화하고, 단순한 질의응답에서는 빠른 응답 속도를 선택할 수 있게 하여 운영 효율성을 높여줍니다.

DeepSeek V3

`경제적 효율성과 독창적 아키텍처`

딥시크의 V3 모델은 AI 모델의 경제적 가치를 재정의하고 있습니다. 6,710억 개의 거대한 파라미터를 보유하고 있음에도 불구하고, 실제 추론 시에는 370억 개의 파라미터만 활성화하는 MoE 구조를 극대화하여 비용 효율성을 높였습니다.

딥시크 아키텍처의 가장 차별화된 점은 MLA(Multi-head Latent Attention) 기술입니다. 기존의 Attention 메커니즘은 문맥이 길어질수록 메모리 사용량이 급증하는 한계가 있었습니다. 딥시크는 키(Key)와 값(Value) 정보를 잠재 공간(Latent Space)으로 압축하여 캐싱하고, 추론 시에만 압축을 해제하는 방식을 통해 메모리 사용량을 획기적으로 절감했습니다.

더불어 딥시크는 16비트나 32비트가 아닌 8비트(FP8) 형식으로 모델을 기본 학습시키는 기술적 돌파구를 마련했습니다. 이는 학습 비용을 대폭 낮추면서도 모델의 성능 저하를 방지하여, 대규모 모델 운영에 부담을 느끼는 기업들에게 실질적인 해결책을 제시합니다.

모델 선택의 기준

이 세 가지 모델은 각기 다른 기술적 경로를 통해 높은 성능을 달성하고 있습니다. 기업의 의사결정권자들은 단순히 벤치마크 점수만 비교할 것이 아니라, 다음과 같은 전략적 관점에서 접근해야 합니다.

컨텍스트 활용 방식의 차이: GPT OSS는 초기 학습부터 긴 문맥 처리에 특화되어 있고, Qwen 3는 추론 단계에서 이를 확장하며, 딥시크는 단계적 미세 조정을 통해 이를 구현합니다. 자사의 비즈니스 데이터가 얼마나 긴 문맥을 요구하는지에 따라 적합한 아키텍처가 달라질 수 있습니다.

데이터 엔지니어링의 내재화: 각 연구소는 모델의 가중치를 공개하면서도, 구체적인 학습 데이터 셋의 구성은 철저히 비공개로 유지하고 있습니다. 이는 모델의 성능을 결정짓는 진정한 경쟁력이 단순히 파라미터 수나 아키텍처의 설계뿐만 아니라, 양질의 데이터를 선별하고 가공하는 프로세스에 있음을 보여줍니다.

인프라 최적화와 경제성: 딥시크와 같이 8비트 학습이나 독창적인 메모리 절감 기술을 도입한 모델은 온프레미스(On-premise) 환경에서 독자적인 모델을 구축하고자 하는 기업에 큰 경제적 이점을 제공합니다.

기술적 이해를 바탕으로 한 맞춤형 도입

이제 오픈소스 AI 모델은 단순히 폐쇄형 모델의 대안이 아니라, 기업의 특정 요구사항에 최적화된 엔진으로 진화했습니다. GPT OSS의 안정적인 설계, Qwen 3의 방대한 지식과 유연한 추론 모드, 그리고 DeepSeek V3의 압도적인 경제성은 각기 다른 비즈니스 시나리오에서 강점을 발휘합니다.

기업은 이러한 아키텍처의 미묘한 차이를 이해하고, 자사의 서비스 특성에 가장 부합하는 모델을 선택하여 실험을 시작해야 합니다. 기술적 배경 지식을 갖춘 상태에서 접근할 때, 비로소 AI 도입을 통한 실질적인 생산성 향상과 비즈니스 가치 창출이 가능해질 것입니다.

우리 회사에 맞는 AI 전환을 함께 설계합니다.

30+ 대기업이 신뢰한 핸즈온 강의·PoC 파트너. 권앤컴퍼니의 AI 도입 뉴스와 사례는 격주 뉴스레터로도 받아보실 수 있습니다.